生成AIを使ってコンテンツを制作する企業は増えています。その一方で、「AI利用はどこまで開示すべきか」という判断基準は、十分に整理されているとは言えません。

法的義務なのか、それとも任意対応なのか、どの範囲まで開示すれば実務上妥当なのか。AI活用が当たり前になった今、この問いは多くの企業にとって現実的なテーマになっています。

日経BPの調査によると、日本企業の64.4%が生成AIツールを導入済みです(2025年7月時点)。一方で、AI利用に関する開示ポリシーを明確に定めている企業はまだ多くありません。2026年8月にはEU AI規制法の全面適用も予定されており、透明性への関心は今後さらに高まると見られます。

本記事では、AI開示ポリシーに法的義務があるのかという点を整理したうえで、実務上どこまで対応すべきかの判断軸を整理します。

▼この記事の監修者

- ●

予算に応じた戦略設計とマーケ全体の支援力 - ●

顧客視点とデータに基づく確かな実行力 - ●

現場目線で気軽に相談できる伴走型パートナー

AI開示ポリシーとは?法規制・プラットフォーム・消費者の3要因で必要性が高まっている

AI開示ポリシーとは、企業が生成AIをどの工程で利用し、最終的な責任を誰が負うのかを明示するための方針です。透明性の確保と信頼構築を目的とし、近年は企業ガバナンスの一部として位置づけられつつあります。

AIは、コンテンツ制作だけでなく、顧客対応、データ分析、広告最適化、商品レコメンド、社内業務効率化など、さまざまな業務プロセスに組み込まれ始めています。その結果、企業活動のどこにAIが関与しているのかが外部から見えにくくなっています。

例えば、以下のような活用をしている場合は、いずれも開示の検討対象になり得ます。

- 生成AIを用いてブログ記事やホワイトペーパーの構成案・初稿を作成している

- チャットボットにAIを組み込み、顧客対応の一次応答を自動化している

- 顧客データの分析や需要予測にAIを活用している

- 商品説明文やレコメンド表示をAIで自動生成している

「AIを使っているけれど、ごく一部だから開示は不要ではないか」と感じるケースもあるでしょう。重要なのは、利用割合の大小ではなく、外部との接点や意思決定にAIが関与しているかどうかです。

そのため、企業側が整理すべきは「利用の有無」そのものではなく、利用範囲と責任の所在をどのように位置づけるかです。AIを補助的に使っているのか、自動生成をそのまま公開しているのか。最終判断は人間が担っているのか。誤情報が生じた場合の責任主体はどこにあるのか。

AI開示ポリシーは、これらを対外的に説明可能な状態にしておくための枠組みです。

では、なぜ今このポリシーが現実的なテーマになっているのでしょうか。その背景には、「法規制」「プラットフォーム」「消費者」という3つの変化があります。

1. EU AI規制法(AI Act)の全面適用が2026年8月2日に予定されている

現在、AI利用の透明性を求める規制は世界的に強まりつつあります。その象徴的な動きが、EU AI規制法(AI Act)の全面適用です。2026年8月2日から本格的に適用される予定となっており、生成AIを含む幅広いAI活用に対して一定の透明性措置が求められます。

特に生成AIについては、利用者がAI生成物であることを誤認しないようにするための対応や、用途に応じた説明責任の明確化が盛り込まれています。EU域内向けにサービスを提供する企業や、EU企業と取引関係を持つ企業にとっては、実務上の影響を無視できません。

日本国内では現時点で、生成AIの利用を一律に開示義務とする法律はありません。ただし、景品表示法や個人情報保護法などとの関係で、表示や説明の妥当性が問われる可能性はあります。

そのため、「今すぐ全面的な義務がある」という状況ではないものの、企業側が自主的に整理しておく必要性は確実に高まっています。

2.プラットフォームの評価基準はAI利用の透明性を重視している

法規制だけでなく、プラットフォーム側(検索エンジンやSNS、広告配信基盤)の評価基準も変化しています。

まず検索領域では、GoogleはAI生成コンテンツそのものを一律に否定しているわけではありませんが「誰が責任を持って公開しているのか」「独自性や監修体制があるか」といった点を重視しています。

検索品質評価ガイドラインでは、E-E-A-T(経験・専門性・権威性・信頼性)の観点が強調されており、AIを活用している場合でも、人間による監督や編集責任が明確であることが前提になります。自動生成をそのまま大量公開する運用は、評価上のリスクを伴う可能性があります。

SNS領域でも同様です。例えば、Instagram(Meta)では、生成AIによって作成・編集された画像や動画に対して「Made with AI(AIで作成)」といったラベル表示を付与する仕組みを導入しています。特定の編集ツールやメタデータを検知した場合、自動的にAI生成コンテンツとして識別される仕様です。

現時点で厳格な統一基準があるわけではありませんが、プラットフォーム側が「AI利用を隠すこと」ではなく、「透明に示すこと」を前提とする方向へ全体が動いていると見るのが妥当でしょう。

3.消費者の透明性期待は企業の説明責任を高めている

AI活用はすでに一般化しており、読者の多くもAIの存在自体を特別視しているわけではありません。しかし、企業がAIをどのように利用しているのかが見えない状態に対しては、不安や疑問が生じやすい傾向があります。

特に、誤情報や誤認表示が社会問題として取り上げられる場面が増える中で、企業に求められているのは「AIを使っているかどうか」ではなく、「どのように管理し、責任を持っているかを説明できるか」という点です。

Zendeskの『CXトレンドレポート(2026年版)』によると、75%の企業が「透明性の欠如は将来的な顧客離れにつながる可能性がある」と認識しています。これは倫理論というよりも、レピュテーションリスクの問題と捉えるべきでしょう。

AI活用が高度化するほど、利用プロセスは外部から見えにくくなります。説明がなければ、問題がないと証明することもできません。結果として、受け手にとっては判断できない状態が残ります。だからこそ、利用範囲と責任の所在を整理し、説明可能な状態にしておくことが求められています。

AI開示ポリシーの実例

具体的な文章イメージがないと、どこまで書けばよいのか判断しにくいかもしれません。ここでは、株式会社toritokeが実際に公開しているAI開示ポリシーの一例をご紹介します。

本サイトでは、コンテンツの作成・編集・校正・構成検討などの一部工程において、生成AI(人工知能)を活用する場合があります。

AIの活用にあたっては、情報の正確性・最新性・信頼性に十分配慮し、公開前に人の目による確認・編集を行うことを基本方針としています。

ただし、AIを活用したコンテンツには、法令改正や制度変更、解釈の違い、個別の状況によって、情報の内容や適用結果が異なる場合があります。

そのため、実務への適用や最終的な判断にあたっては、最新の公式情報等をご確認のうえ、ご自身の責任においてご判断ください。なお、本サイトのコンテンツは、AIの自動生成のみで完結するものではなく、運営者の判断・経験・知見をもとに編集・監修されたものです。

この例では、次の3点を明確にしています。

- AI利用の範囲(どの工程で使っているか)

- 品質管理の方法(人の確認・編集が入ること)

- 最終的な責任の所在(運営者が監修していること)

網羅的にすべてを書いているわけではありませんが、「どのように使い、どう管理しているか」は伝わる構成になっています。

AI開示ポリシーは、最初から完璧に設計する必要はありません。まずはこのようなシンプルな形で公開し、実際の運用に合わせて更新していくことが現実的です。

AI開示ポリシーはどこまで整備すれば十分か

AI開示ポリシーは、すべての企業が同じ水準で整備する必要はありません。重要なのは、自社のAI活用の範囲とリスク水準に応じて、説明の深さを決めることです。

実務上は、次の3段階で考えると整理しやすくなります。

① 最低限の水準(中小企業向け)

AIをコンテンツ制作の補助や業務効率化に限定して活用している企業であれば、まずは最低限の開示で十分です。重要なのは、AIを使っている事実そのものよりも、「どこまで関与しているのか」「最終的な責任は誰が負うのか」を明確にすることです。過度に詳細なリスク分析や法的整理まで踏み込む必要はありません。利用範囲と責任の所在を簡潔に示すことで、基本的な透明性は担保できます。

記載する項目

- AI利用の範囲を明示(どの工程で活用しているか)

- 人による確認があることを記載(最終的な公開判断は人が行うこと)

- 運営主体を明示(責任の所在を明確にすること)

対象となる会社

- コンテンツ制作中心の企業

- 中小規模で海外規制の直接的影響が小さい企業

- まずは基本的な透明性を確保したい企業

② 標準的な水準(実務重視型)

自社の情報発信が、顧客の意思決定や契約判断に直接影響する企業では、最低限より一段踏み込んだ開示が望まれます。たとえば、専門性の高い分野(金融、法務、医療、投資、不動産など)で実務判断に関わる情報を提供している場合や、BtoBで契約判断に直結する資料を公開しているケースです。

この場合は、単に「AIを使っています」と示すだけでなく、品質管理や修正体制まで整理することで、統制された運用であることを説明できます。

記載する項目

- AI利用の範囲と目的(工程単位で具体的に記載)

- 人による監修・編集体制(担当部署や確認フロー)

- 品質管理プロセス(事実確認・更新方針・修正対応)

- 誤情報発生時の対応方針

- 問い合わせ窓口の明示

対象となる会社

- 金融・医療・法務など高リスク領域の企業

- 実務判断や契約判断に影響する情報を提供している企業

- 情報の誤りが経済的損失につながり得る企業

③ 高度な水準(規制・海外対応型)

海外展開を行っている企業や、規制業界に属する企業では、AI開示ポリシーをガバナンス文書の一部として整備する水準が求められる場合があります。単なる説明文ではなく、リスク評価、法規制対応、データ管理方針との整合性まで整理します。AIの利用状況を社内統制と結びつけて示すことで、対外的な信頼水準を高める設計です。

記載する項目

- AIリスク評価の枠組み(用途分類・影響度評価)

- 関連法規との整合性(EU AI Act 等への対応方針)

- データ利用・個人情報保護との接続

- 社内統制体制(承認プロセス・ログ管理)

- 定期的な見直し・更新方針

対象となる会社

- EU圏と取引がある企業

- 規制業界(金融・医療・公共領域など)

- 上場企業や大規模組織

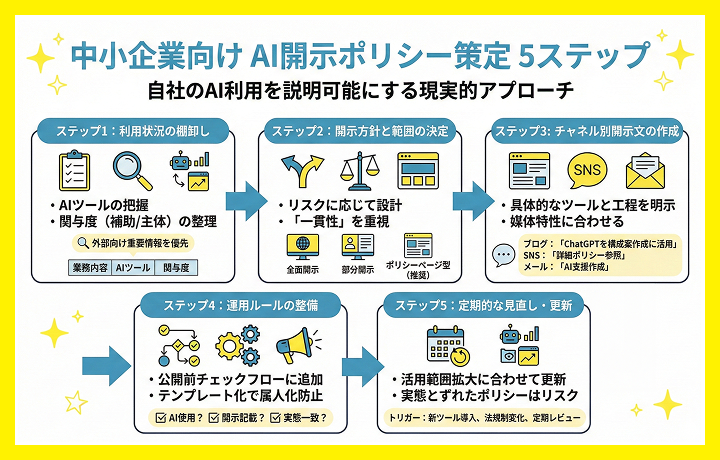

中小企業向け AI開示ポリシー策定の5ステップ

AI開示ポリシーは、自社がどのようにAIを使い、どう管理しているのかを説明できる状態をつくることが目的です。ここでは、中小企業が進められる、現実的な5つのステップを紹介します。

ステップ1:自社のAI利用状況を棚卸しする

最初に行うのは現状把握です。どの業務で、どのAIツールを、どの程度使っているのかを整理します。重要なのは「利用しているかどうか」ではなく「どの工程にどの程度関与しているか」を明確にすることです。補助的利用なのか、主体的に生成しているのかで開示の考え方は変わります。

- 業務内容

- 使用AIツール

- 利用頻度

- AI関与の度合い(補助/主体)

この整理が、ポリシー設計の土台になります。

さらに、AIが「外部向けの情報」に関与しているかどうかも確認します。社内メモ作成と、顧客に公開されるコンテンツでは、透明性の重要度が異なります。特に、顧客の意思決定や契約判断に影響する情報にAIが関与している場合は、優先的に整理が必要です。棚卸しの段階でリスクの大きさを把握しておくことで、過不足のない開示設計が可能になります。

ステップ2:開示の方針と範囲を決める

次に、「どこまで開示するか」の方針を決めます。最初から網羅的に整備する必要はありません。自社の規模やリスク水準、情報発信の影響度に応じて設計します。

- 全面開示:すべてのコンテンツで明示

- 部分開示:AI関与が大きい場合のみ明示

- ポリシーページ型:サイト全体で一括説明

重要なのは一貫性です。コンテンツごとに判断がぶれると、かえって不信感を生みます。まずはポリシーページ型で全体方針を示し、主体的利用がある領域のみ個別表記を加える方法が現実的です。自社のリスクと運用負荷のバランスを見て決めます。

ステップ3:チャネル別の開示文を作成する

方針が決まったら、実際の文面を作成します。抽象的な記載は避け、「どのツールを」「どの工程で」使っているのかを具体的に示します。「AIを活用しています」と書くよりも、「ChatGPTを構成案作成と文案ドラフトに活用しています」と明示するほうが、透明性は高まります。

- ブログ用開示文

- SNS用簡易表記

- メルマガ用表記

チャネルごとに適切な粒度を設計することが重要です。長文のポリシーはサイト側に置き、SNSでは簡潔に誘導するなど、媒体特性に合わせた表現を選びます。

ステップ4:社内周知と運用ルールを整備する

ポリシーは作成して終わりではありません。日常業務に組み込むことで初めて機能します。公開前チェックフローにAI利用確認を追加し、判断基準を共有します。

- AIを使用したか

- 開示文を記載したか

- 記載内容は実態と一致しているか

さらに、利用ルールと開示内容が矛盾していないかも確認します。WordPressの投稿テンプレートにひな形を組み込むなど、仕組み化することで属人化を防ぎます。運用が安定すれば、説明責任も安定します。

ステップ5:定期的に見直し・更新する

AI開示ポリシーは固定文書ではありません。AIの活用範囲は時間とともに広がる傾向があります。そのため、定期的な見直しを前提に設計します。

- 新しいAIツールを導入したとき

- 法規制や業界ルールに動きがあったとき

- 四半期レビューのタイミング

ステップ1で作成した利用状況リストを更新し、開示内容との整合性を確認します。実態とずれたポリシーは、透明性を高めるどころかリスクになります。更新を前提とした運用設計が重要です。

AI開示は「リスク対策」ではなく「信頼構築」の手段

AI開示ポリシーの策定は、法規制への対応という側面もありますが、それ以上に、読者や顧客との信頼関係を築くための取り組みです。

本質は、自社がどのようにAIを活用し、どのように管理し、誰が責任を負っているのかを説明できる状態をつくることにあります。AIを使っているかどうかが問題なのではなく、説明できる構造になっているかどうかが問われています。

利用範囲が整理され、確認体制が明確で、責任の所在が示されていれば、それ自体が信頼の土台になります。透明性は守りの施策ではなく、企業姿勢を示す手段です。

透明性のあるコンテンツ制作は、読者からの信頼獲得につながります。AI時代にふさわしい情報発信のあり方を、今一度整理してみてはいかがでしょうか。

- ●

予算に応じた戦略設計とマーケ全体の支援力 - ●

顧客視点とデータに基づく確かな実行力 - ●

現場目線で気軽に相談できる伴走型パートナー

新しい検索体験「LLMO」とは?SEOとの違いとAI時代の検索対策を解説

コメント